チャットGPT 3.5とチャットGPT 4のトークンリミットはどのくらいですか?

February 20, 2025

February 20, 2025

January 10, 2026

January 10, 2026

GPT チャット 大量のテキストを処理できます。ただし、すべてのチャット、プロンプト、応答には依然としてトークンの制限があります。

これらの制限は、モデルが処理できるコンテキストの量、応答時間、ChatGPT が以前のメッセージをどの程度記憶するかに影響します。GPT-3.5と初期のGPT-4以降、ルールも大きく変わりました。

このガイドでは、次のことを学びます。

- ChatGPTトークンとは何か、トークン使用量の測定方法

- ChatGPTモデルとプラットフォーム間のトークン制限の違い

- GPT3.5、GPT-4、GPT-4O、GPT-4.1の現在のトークンリミット

- モデルの制限内で作業する実践的な方法

- Tactiqのようなツールがトークンのサイズを超える長い形式のワークフローを改善する場合

ChatGPTトークンとは何ですか?

ChatGPTトークンは、言語モデルが処理するテキストの単位です。

1 つのトークンには次のものがあります。

- 1 つの単語

- 単語の一部

- 句読点または記号

- スペースまたは英語以外の文字

平均すると、1つのトークンは英語で約0.75語に相当します。この測定値はモデル間で一貫しています。

単語数とトークン数は関連していますが、同じではありません。長い単語、コード、および英語以外のテキストでは、予想よりも多くのトークンが使用されることがよくあります。

トークンはインタラクション全体で使用されます。

- システムメッセージ

- システムプロンプト

- ユーザー入力

- モデルの応答

モデルのトークン制限に達すると、モデルはその出力を短くするか停止しなければなりません。

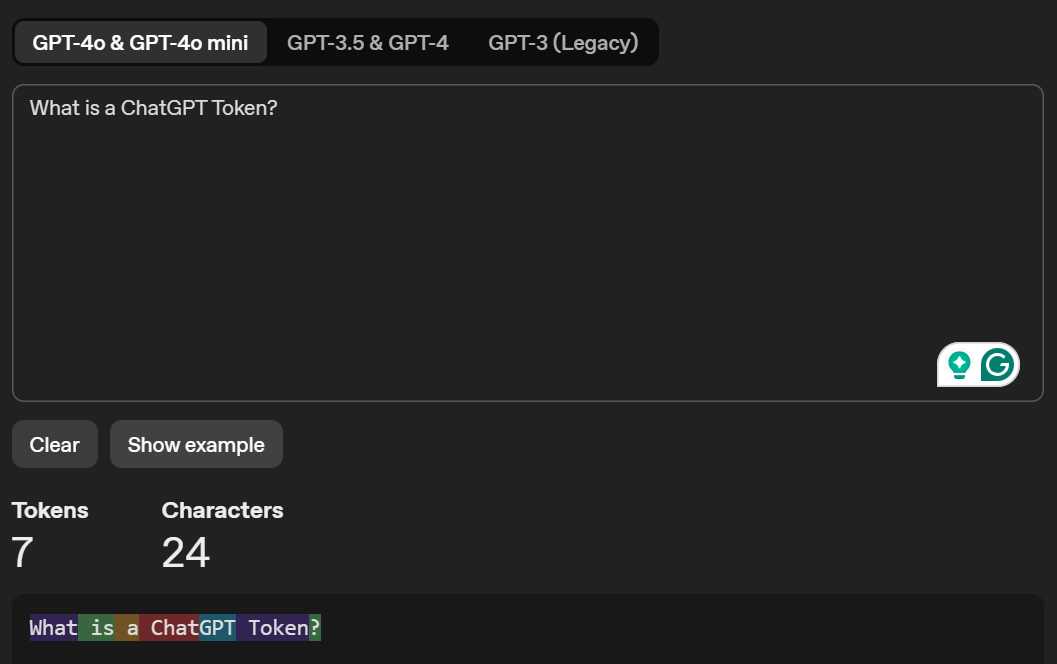

アクセスできます OpenAI のトークナイザー AI言語モデルがどのようにテキストをトークン化し、トークンの合計数を表示するかを視覚化します。Tokenizer で入力したサンプルテキストは次のとおりです。

以下についても詳しく知ることができます 無料チャットと有料チャット (GPT) トークンの上限。

プロのヒント: 会議の議事録が20,000トークンを超えることが多く、ChatGPTでテキストを分割したり、コンテキストを失ったりすることになります。 タクティク ズーム、Google Meet、Microsoft Teams からの会議を自動的にキャプチャして要約します。トークンの制限やコピーアンドペーストは不要です。

ChatGPT-3.5トークンの制限について教えてください。

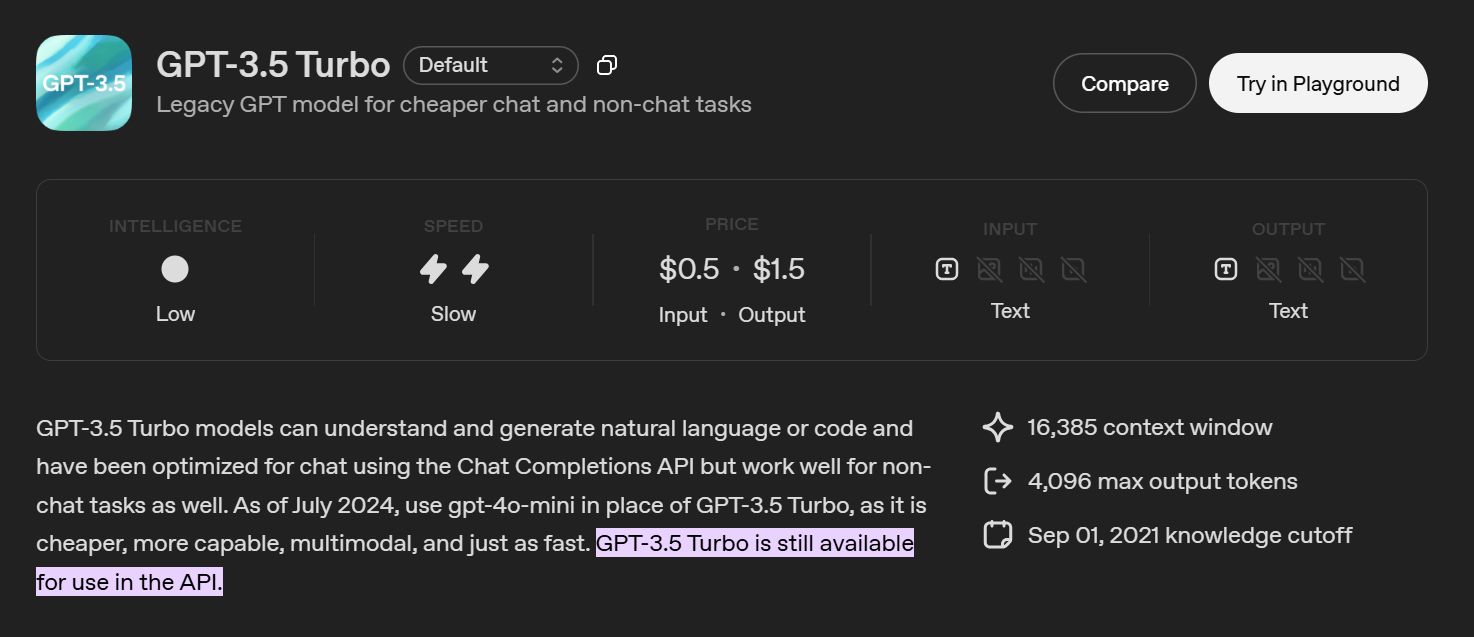

GPT-3.5 現在、レガシーChatGPTモデルと見なされています。ほとんどのユーザーには ChatGPT インターフェースには表示されなくなりました。これは主に ChatGPT API を通じて利用できるようになっています。

標準の gpt-3.5 ターボモデルは以下をサポートします。

- API リクエストごとに合計 16,385 トークン

- トークンは、入力、システムメッセージ、会話履歴、および出力間で共有されます

- モデルの応答は、残りのトークンバジェットに収まる必要があります

プロンプトが長い場合や入力が大きいと、最大応答サイズが小さくなります。

GPT-3.5がまだ使用されている場所

- API ベースのツールとスクリプト

- コスト重視のタスク

- 短いプロンプトとシンプルなチャットフロー

GPT-3.5は、長いトランスクリプト、大きな文書、または複雑な推論には適していません。新しいモデルでは、より長いコンテキスト長と構造化された出力をより確実に処理できます。

ChatGPT-4トークンリミットとは何ですか?

ChatGPT-4には固定のトークン制限はありません。制限は以下によって異なります。 型 そして プラットフォーム。

レガシー GPT-4

ほとんど非推奨。

- コンテキストの長さ: 最大 8,192 トークン

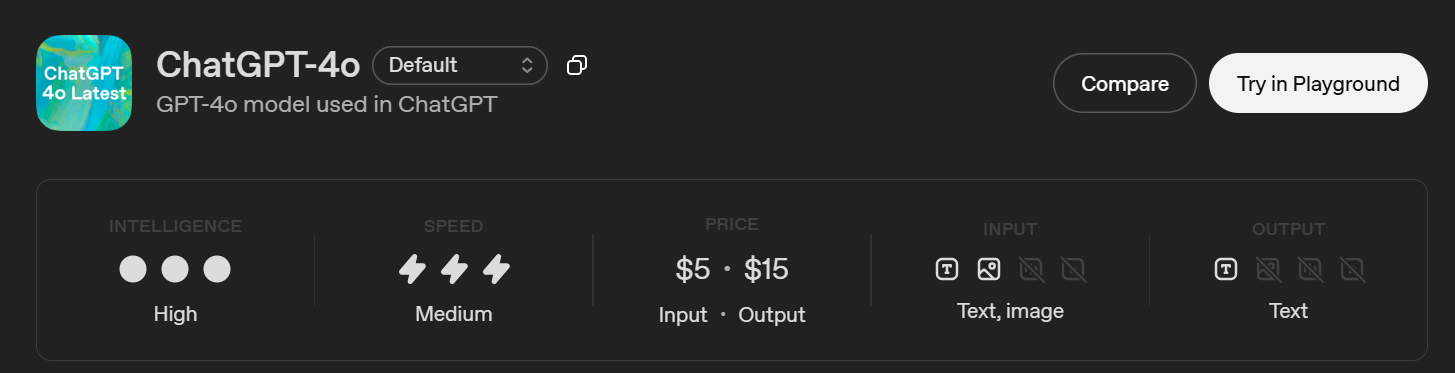

チャット GPT-4 (チャット GPT)

これはチャットGPTで使われているGPT-4モデルです。

- コンテキストウィンドウ: 128,000 トークン

- 最大出力: 16,384 トークン

- ナレッジカットオフ: 2023年10月1日

ChatGPTは引き続き応答上限を適用するため、モデルは大きな入力を受け付けても短い回答を返す場合があります。

GPT-4.1 (API のみ)

長期にわたる構造化されたワークロード向けに構築されています。

- コンテキストウィンドウ: 1,047,576 トークン

- 最大出力: 32,768 トークン

- ナレッジカットオフ: 2024年6月1日

キーポイント

ChatGPT-4 トークンの上限は 1 つではありません。制限は以下によって異なります。

- チャット GPT モデル

- チャット GPT UI と OpenAI API

- コンテキストの長さと出力上限

ChatGPTトークンの制限はどのように機能しますか?

使用したことがある場合 GPT チャット セッションが長くなると、時間が経つにつれて応答が短くなることに気づいたでしょう。これは、長いテキストを貼り付けたり、会話を続けたり、以前の回答に対してフォローアップの質問をしたりした後に起こるのを見てきました。

これはトークン制限の仕組みにかかっています。

すべてのチャットで共有されるトークンの予算は1つです。これには、システムメッセージ、プロンプト、会話履歴、モデルの応答が含まれます。チャットが拡大するにつれて、ChatGPTが回答を生成し始める前に、すでに多くのトークンが使用されています。

コンテキストの長さと応答の長さも異なります。モデルは大量の入力を受け付けても、出力の生成が早い段階で停止することがあります。ほとんどの ChatGPT インターフェイスでは、レスポンスの長さはコンテキストウィンドウ全体以下に制限されています。

そのため、長時間のチャットでは、以前の詳細が失われたり、回答の途中で途切れたりすることがあります。これはバグではありません。モデルが限界に達しているのです。

一部のユーザーは、次のようなブラウザベースのツールも探しています GPTアトラスチャット 長時間のチャットを整理できます。これらのツールはトークンの上限を増やすことはありませんが、会話をより適切に管理するのに役立ちます。

チャットGPT-3.5とチャットGPT-4にはどのような違いがありますか?

紙の上では、GPT-3.5とGPT-4はどちらもテキストを生成します。実際には、長いインプット、複雑なタスク、継続的な会話を処理し始めると、動作が大きく異なります。

この違いは、短いプロンプトから実際の作業(トランスクリプトのレビューや複数ステップのタスクを繰り返すなど)に移行したときに最も顕著に感じられました。

コンテキストウィンドウと出力制限

GPT3.5 ターボ は 16K のコンテキストウィンドウをサポートしますが、最大出力は 4,096 トークンに制限されています。つまり、プロンプトが長いと、応答に使用できるスペースがすぐにいっぱいになってしまいます。

GPT-4 チャットこれとは対照的に、128Kのコンテキストウィンドウをサポートし、最大16,384トークンの応答を生成できます。すぐに制限に達することなく、はるかに多くの背景情報を提供できます。

GPT-4.1 APIのユースケースではこれをさらに推し進め、100万個以上のトークンのコンテキストウィンドウとはるかに高い出力上限を設けています。これにより、サイズの大きい文書や長い会話履歴へのアプローチ方法が変わります。

能力と推論の違い

GPT-3.5 基本的なテキストとコード生成に最適化されています。単純なタスクには使えますが、以下の点では問題があります。

- 長い説明

- マルチステップロジック

- 会話全体での一貫性の維持

GPT-4-class モデルはこれらをより適切に処理します。次のことがわかりました。

- 指示に厳密に従ってください

- コンテキストが失われる頻度が低い

- より体系的で首尾一貫した回答を作成

これはトークンだけの問題ではありません。基盤となるアーキテクチャとトレーニングデータは異なるため、幻覚が減り、推論の精度が向上します。

モダリティと機能

GPT-3.5 はテキストのみで、サポートする機能セットは限られています。

GPT-4 チャット サポート:

- テキストと画像の入力

- より大きなコンテキスト処理

- チャットベースのワークフローのパフォーマンスの向上

GPT-4.1 ツール呼び出し、構造化された出力、大容量処理などの高度な API 機能のサポートが追加されているため、プロダクションシステムに適しています。

費用と推奨用途

GPT-3.5 トークンあたりのコストが低く、コスト重視のAPIタスクでも引き続き表示されます。とはいえ、OpenAI は現在、ほとんどのユースケースにおいて新しいモデルを推奨しています。

実際のワークフローでは、 GPT-4 クラスのモデル プロンプトが数段落を超えたり、タスクに持続的なコンテキストが必要になったりすると、信頼性が高まります。

本当のテイクアウト

GPT-3.5とGPT-4の違いは、サポートするトークンの数だけではありません。

彼らがどれほどうまくいっているかです:

- コンテキストを管理

- 指示に従う

- 長時間の入力にも故障なく対応

トークンは重要ですが、ストーリーの一部にすぎません。

トークンの制限を回避する方法

トークンの制限は、以前ほど制限が少なくなっています。しかし、モデルが 1 回の応答でどの程度処理して返すことができるかは、依然としてこの制限によって決まります。実際には、適切なアプローチは、モデルの選択、プロンプトの構造、および時間の経過に伴うコンテキストの管理方法によって異なります。

コンテキストウィンドウが大きいモデルを使用する

アクセスできる場合は、長期的なコンテキスト向けに設計されたモデルから始めてください。

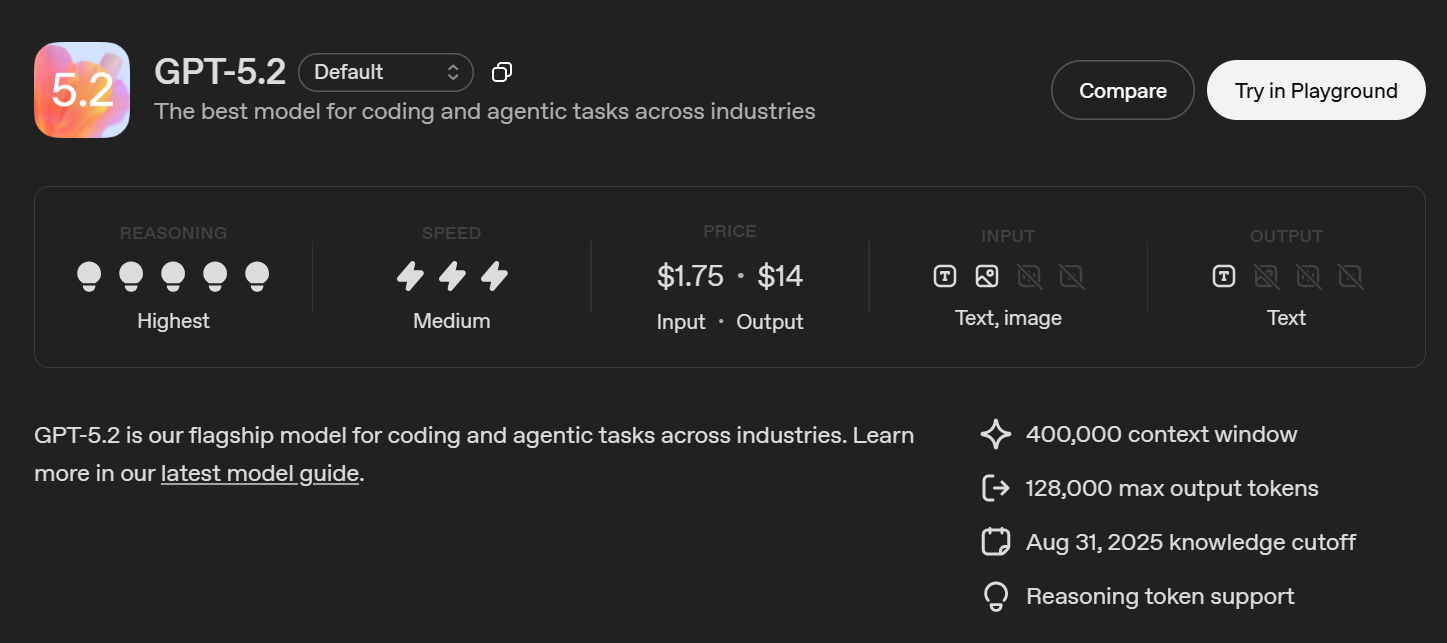

GPT-5、GPT-4o、GPT-4.1などの新しいモデルは、以前の世代よりもはるかに大きなコンテキストウィンドウをサポートします。これにより、長いテキストや進行中のタスクを処理しているときに、入力をトリミングしたり、会話を再開したりする頻度が減ります。

とはいえ、コンテキストが大きいからといってすべての制限がなくなるわけではありません。

出力にはまだ上限があります

モデルが大量の入力を受け入れることができる場合でも、最大出力トークンははるかに小さい場合があります。これは通常、応答が早く終了したり、応答が不完全だと感じたりした場合に現れます。

その場合:

- モデルにフォローアップメッセージで続けるよう依頼する

- 完全な複製ではなく要約をリクエストしてください

- タスクを複数のステップに分ける

これにより、各応答をモデルの出力制限内に保つことができます。

大量の入力を意図的にチャンクする

現代のモデルでも、チャンク化は引き続き役立ちます。

通常、長いコンテンツは次の方法で分割されます。

- セクション

- トピックス

- トランスクリプトの時間範囲

各チャンクは個別に処理され、結合または要約されます。これにより、トークンのプレッシャーが軽減され、回答の焦点が絞られます。

要約を使用してコンテキストを保存する

すべての会話履歴を引き継ぐ代わりに、以前のメッセージを要約し、その要約を入力として再利用してください。

これにより、重要な詳細情報を保持しながらコンテキストをコンパクトに保つことができます。特に、長時間のチャットや複数ステップのワークフローで役立ちます。

API のベストプラクティス

API を使用して作業している場合:

- セット max_token 各 API 呼び出しについて

- 応答をストリーミングして単一出力が大きくならないようにする

- 会話履歴全体を再送信する代わりに、手動で状態を維持する

GPT-5や拡張コンテキストモデルを使用しても、トークンの慎重な使用は依然として重要です。

複雑な質問を簡略化

長い説明と完全なトランスクリプトでは、トークンの使用が速くなります。私たちはこれに頻繁に遭遇しました 会議メモ。

すべてを貼り付ける代わりに、必需品に集中してください。例えば:

「この会話の主な決定事項とアクションアイテムを要約してください。」

これにより、入力サイズが小さくなり、より明確な応答が得られます。

回避策が不十分な場合

GPT-5やGPT-4.1のようなモデルでも、要約やチャンク化にはまだ手間がかかります。ある時点で、問題はトークンの制限ではなくなり、ワークフローのオーバーヘッドになります。

そこで、長いトランスクリプトとアウトプットを整理するために構築されたツールが重要になります。

TactiqがChatGPTトークンの制限を超える長いトランスクリプトを処理する方法

大きなコンテキストウィンドウが役立ちます。しかし、仕事に長いトランスクリプトや定期的な会議が含まれる場合、課題となるのはトークンではなく、構造です。

タクティク は、オンライン会議用に設計されたAI会議の文字起こしおよびメモ作成ツールです。ライブトランスクリプトをキャプチャして、要約、アクションアイテム、検索可能なメモに変換します。

Tactiqはズーム、マイクロソフトチームズ、グーグルミートと連携しています。有料のサブスクリプションは不要で、無料で使い始めることができます。

主なメリット:

- 手動でコピーしなくても会議の議事録全体をキャプチャ

- メモを要約とアクションアイテムにまとめる

- 会議後も会話を検索できるようにする

- プロンプトの記述とコンテキスト管理を減らす

- 定期的な会議や長時間のディスカッションに適しています

GPT-5 や GPT-4.1 のような拡張コンテキストモデルを使用しても、長い会話を整理するには依然として手間がかかります。Tactiqは、より多くのコンテキストを保持するだけでなく、会議コンテンツを利用可能なアウトプットに変えることに重点を置いています。

無料のTactiq Chrome拡張機能をインストールしてください トークンの制限を気にすることなく、会議のインサイトを取得、整理、再利用することができます。

ラッピングアップ

モデルがより大きなコンテキストウィンドウをサポートしているとしても、トークンの制限は依然として重要です。これにより、モデルが処理できる入力の量、応答時間、会話全体でのコンテキストの伝達の信頼性が決まります。

GPT-4o、GPT-4.1、GPT-5などの新しいモデルは摩擦を軽減しますが、摩擦を取り除くことはありません。長いトランスクリプト、繰り返されるミーティング、フォローアップ作業には、トークンを増やすだけでなく、やはり構造が必要です。

ChatGPTはレスポンスを生成するのに適しています。会議を多用するワークフローでは、Tactiqのようなツールは会話を要約、アクションアイテム、検索可能なメモに変換し、チャット終了後も引き続き役立つようにすることに重点を置いています。

長文形式の会議コンテンツを扱うことが多い場合は、大規模なコンテキストモデルと専用のツールを組み合わせることで、時間を節約し、手作業によるオーバーヘッドを減らすことができます。

{{rt_cta_ai-convenience}}

チャットGPT 3.5およびチャットGPT 4のトークン制限に関するよくある質問

ChatGPT-4のトークン制限はどのくらいですか?

単一の制限はありません。ChatGPT-4 トークンの制限はモデルとプラットフォームによって異なります。ChatGPT-4O は 128,000 トークンのコンテキストウィンドウと最大 16,384 個の出力トークンをサポートしますが、GPT-4.1 のような API モデルははるかに大きな制限をサポートします。

GPT-3.5とGPT-4Oの違いはなんですか?

GPT-3.5は短いプロンプトや基本的なタスクを処理しますが、コンテキストが小さく、推論能力が低くなります。GPT-4oは、はるかに広いコンテキスト、強力な推論、および画像入力をサポートしているため、長時間の会話や複雑なタスクに適しています。

GPT-4oのトークン制限はどのくらいですか?

GPT-4oは、128,000トークンのコンテキストウィンドウと最大16,384個の出力トークンをサポートします。入力トークンと出力トークンの予算は同じで、ChatGPT UI の応答上限が適用される場合があります。

GPT-4にはまだ制限がありますか?

はい。すべての GPT モデルには制限があります。コンテキストウィンドウが大きい場合でも、モデルとアクセス方法に基づいて、各リクエストあたりの最大出力サイズと合計トークンの上限は変わりません。

ChatGPT-3.5はいくつのトークンを処理できますか?

GPT-3.5ターボは、APIリクエストごとに合計16,385トークンをサポートし、最大出力は4,096トークンです。これはレガシーモデルと見なされ、主に軽量タスクやコスト重視のタスクに使用されます。

便利なAIサマリーが欲しいですか?

次回のミーティングで Tactiq をお試しください。

便利なAIサマリーが欲しいですか?

次回のミーティングで Tactiq をお試しください。

便利なAIサマリーが欲しいですか?

次回のミーティングで Tactiq をお試しください。