Guía sobre los límites de los tokens de ChatGPT gratuitos y de pago

August 27, 2025

August 27, 2025

August 27, 2025

August 27, 2025

Chat GPT es una herramienta poderosa, pero sus límites simbólicos pueden bloquear el flujo de conversaciones largas o indicaciones detalladas. Cuando un chat alcanza su límite simbólico, los mensajes anteriores se quedan fuera de la memoria y las respuestas pueden reducirse o perder el enfoque.

Al realizar un seguimiento de las asignaciones de fichas en los diferentes modelos y planes o en la capa gratuita, puedes gestionar el contexto de forma más fluida.

En este artículo se explicará qué son los tokens, cómo afectan los límites de los tokens a las solicitudes de API y los chats, y se compartirán formas sencillas de evitarlos.

¿Qué es un token de ChatGPT?

UN Símbolo ChatGPT es la unidad básica que usa el modelo para leer y generar texto. Un símbolo puede ser una sola palabra, parte de una palabra, un signo de puntuación o incluso un espacio en blanco. El modelo no ve el texto como oraciones completas. Divide todo en fichas antes de producir una respuesta.

Algunas pautas rápidas para el inglés:

- Un token ≈ cuatro caracteres

- Una ficha ≈ tres cuartos de una palabra

- 100 fichas ≈ 75 palabras

- Una sola oración ≈ 30 fichas

- Un párrafo ≈ 100 fichas

Otros idiomas suelen utilizar más fichas por carácter. Por ejemplo, la frase «Cómo estás» tiene solo 10 caracteres, pero cuenta como 5 fichas.

Cada vez que escribes texto, ChatGPT lo divide en fichas, las procesa y, a continuación, genera nuevas fichas como respuesta. Por eso es importante el uso de los tokens. Afecta a la longitud de las instrucciones, las respuestas y el historial de conversaciones.

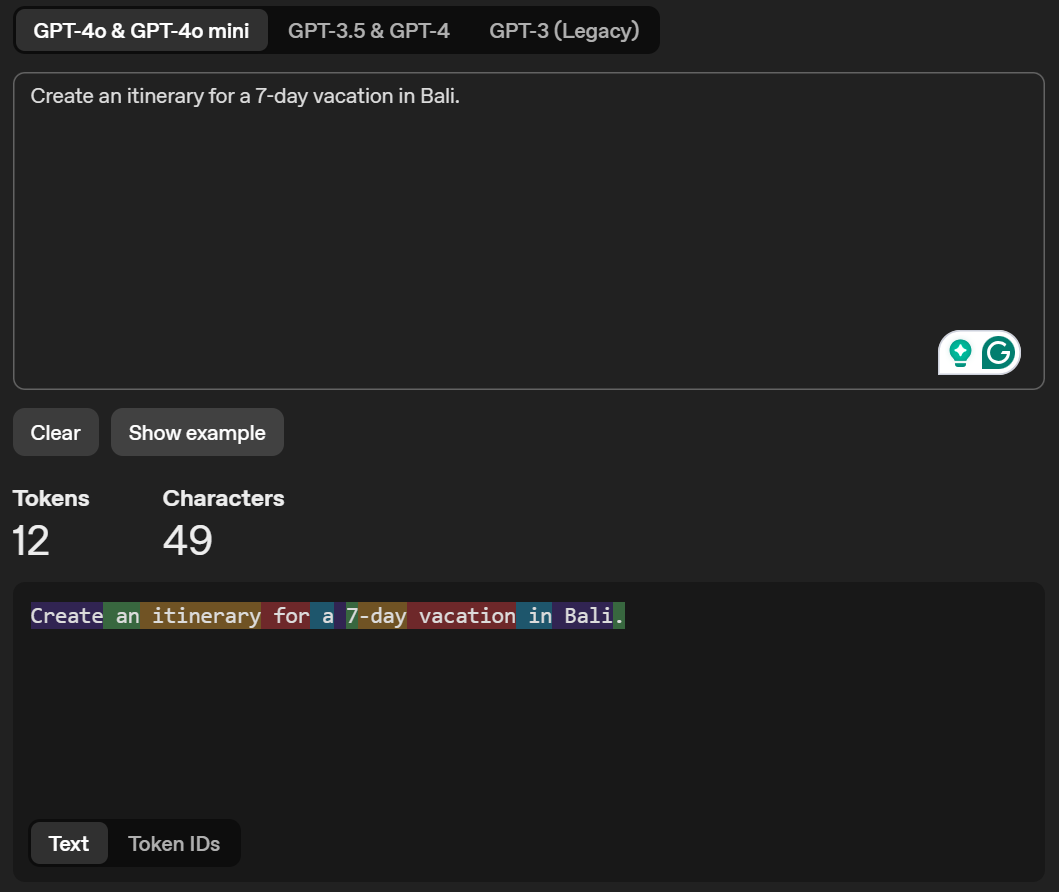

💡 Consejo profesional: Antes de realizar una llamada a la API, prueba Tokenizador de OpenAI. Te permite pegar texto y ver al instante el recuento de fichas para ayudarte a mantenerte dentro del límite del modelo.

A continuación se muestra un texto de muestra que ingresé en el Tokenizer:

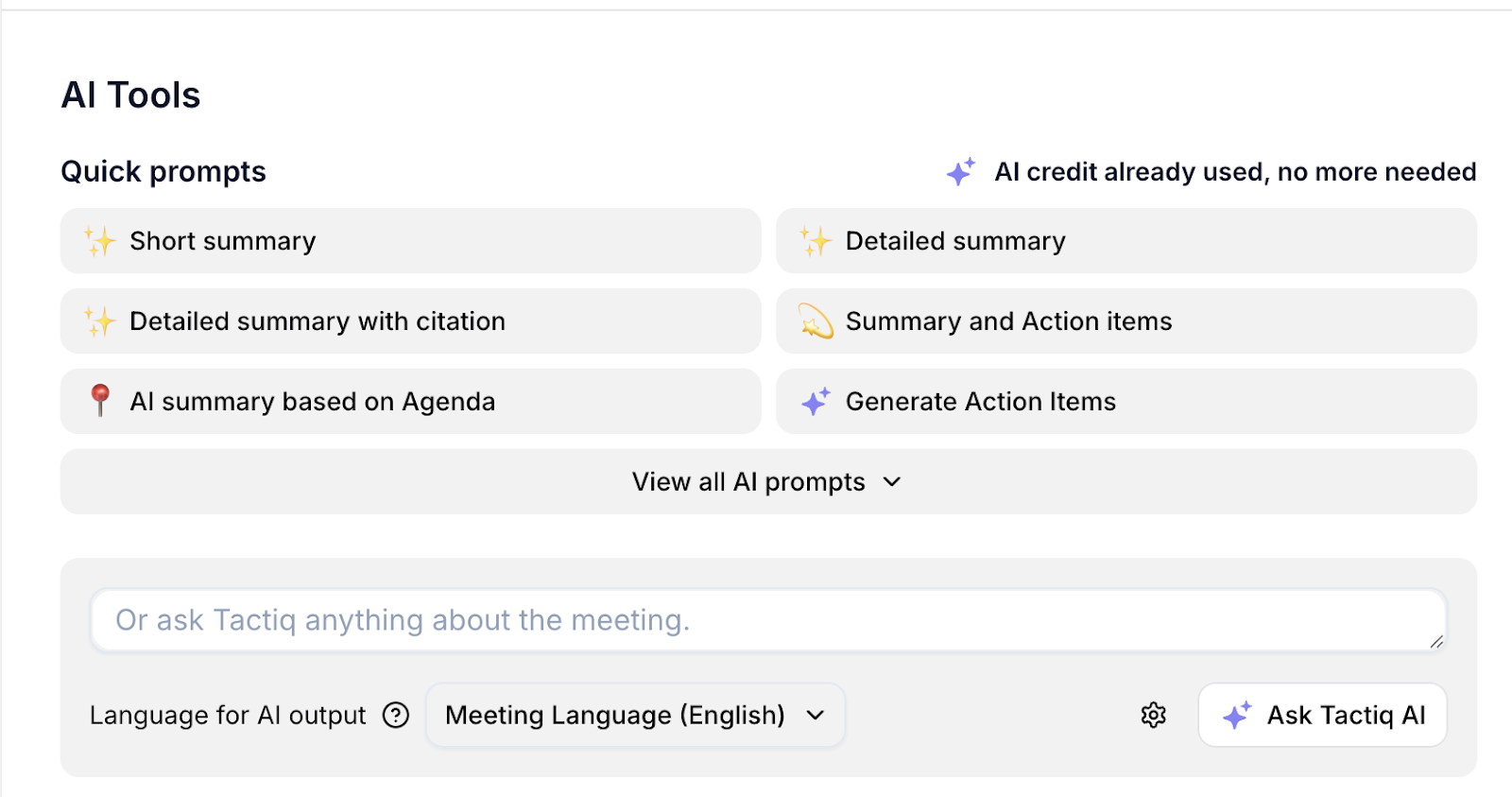

💡 Consejo profesional: Si no quieres preocuparte por consumir muchos tokens al resumir las transcripciones de las llamadas, usa Tactiq. Captura las transcripciones de Google Meet, Zoom y Teams y, a continuación, crea resúmenes basados en inteligencia artificial sin límites de tokens.

¿Cómo funcionan los límites de los tokens de ChatGPT?

Cada modelo de ChatGPT tiene un límite de token, que es la longitud máxima que puede manejar tanto para la entrada como para la salida que genera. Si tu conversación supera el límite de tokens del modelo, los mensajes anteriores del historial de conversaciones se eliminarán y es posible que el modelo reduzca sus respuestas.

Por ejemplo, si tu mensaje usa 50 fichas y la respuesta del modelo es de 150 fichas, el uso total de fichas es de 200. Este recuento combinado se aplica tanto si estás chateando en la aplicación como si envías una solicitud de API.

La capacidad de los tokens depende del modelo de ChatGPT:

- GPT-4: Los modelos originales ofrecían 8.192 y 32.768 fichas de longitud contextual.

- GPT-4 Turbo: Se ha aumentado el número máximo de fichas a 128 000.

- GPT-4.1: Soporte extendido de hasta 1 millón de tokens para conversaciones y documentos largos.

- GPT-5 (2025): Proporciona una ventana de contexto de 256 000 fichas con un razonamiento más rápido.

Cuando se trabaja con la API, el uso de los tokens se rastrea en cuatro categorías principales:

- Tokens de entrada — fichas de tu mensaje.

- Tokens de salida — fichas en la respuesta del modelo.

- Tokens almacenados en caché — tokens reutilizados del historial de conversaciones.

- Fichas de razonamiento — pasos de procesamiento adicionales en modelos avanzados.

Administrar el uso de los tokens le ayuda a mantenerse dentro del límite de tokens del modelo y a evitar que se corten las respuestas. Los límites de los tokens suelen cambiar a medida que OpenAI actualiza sus modelos, por lo que es mejor comprobar el Sitio web de OpenAI para obtener los detalles más recientes.

💡 Consejo profesional: Si usas ChatGPT para las notas de las reuniones, prueba Tactiq. Se conecta a Google Meet, Zoom y Teams para capturar transcripciones y resúmenes de IA sin límites de tokens.

¿Cuáles son las diferencias entre el GPT-5 gratuito y el de pago?

Ahora todo el mundo tiene acceso al GPT-5, pero las versiones gratuitas y de pago difieren en cuanto a los límites de uso y la capacidad de razonamiento.

GPT-5 Gratis

- Funciona con GPT-5 como modelo predeterminado

- Límites de uso diario más bajos

- Cambia a GPT-5 Mini una vez que se alcanzan los límites

- Memoria más corta (ventana de contexto más pequeña)

- Velocidad estándar y sin herramientas avanzadas

GPT-5 de pago (Plus, Pro, Team)

- Límites de uso mucho más altos, con los planes Plus y Team diseñados para el trabajo diario

- Los suscriptores Pro también reciben el GPT-5 Pro, una variante con un razonamiento extendido para problemas más difíciles

- Mayor longitud del contexto para conversaciones y documentos más largos

- Acceso prioritario y respuestas más rápidas

- Herramientas avanzadas como DALL·E, análisis de datos y carga de archivos

Los planes de pago están diseñados para tareas laborales y profesionales más pesadas, mientras que el nivel gratuito permite a todos acceder al GPT-5 de forma más ligera, con Mini como alternativa cuando se alcanzan los límites.

Cómo sortear los límites de los tokens

Incluso con las ventanas de contexto más grandes de GPT-5, los límites de los tokens siguen siendo importantes. Los usuarios que utilizan la versión gratuita tienen menos memoria y las solicitudes de API pueden llegar al límite máximo cuando trabajan con documentos largos. Estas son algunas maneras de aprovechar al máximo el uso de los tokens:

- Mantén las indicaciones claras y específicas.

Concéntrese en la pregunta principal en lugar de agregar detalles de fondo largos. Esto reduce la cantidad de fichas de entrada. - Establece una longitud de respuesta.

Añade instrucciones como «Responda en menos de 200 palabras» por lo que el modelo no usa fichas innecesarias. - Resuma antes de enviarlo.

Si tienes un texto largo, divídelo o pega solo las secciones clave. Ejemplo: «Resuma las siguientes notas de la reunión en 5 puntos de acción». - Divida las tareas grandes en varias llamadas a la API.

En lugar de enviar una solicitud enorme, procese fragmentos de texto paso a paso. De este modo, cada solicitud se mantiene dentro del límite de tokens del modelo. - Recuerde que los mensajes del sistema cuentan.

La línea de comandos del sistema o el mensaje del sistema que configuras en la API también utilizan tokens, así que ten en cuenta eso en tu longitud máxima.

Alternativa apta para transcripciones y resúmenes de reuniones que admite fichas

Si tu objetivo principal es tomar notas de la reunión y resumir las reuniones, los límites de los tokens de ChatGPT pueden parecer restrictivos.

Tactiq simplifica este proceso al conectarse directamente a sus plataformas de videoconferencia favoritas, como Google Meet, Zoom y Microsoft Teams.

En lugar de preocuparte por el máximo de fichas, puedes concentrarte en la conversación mientras Tactiq captura todo en tiempo real y lo convierte en transcripciones, resúmenes y elementos de acción claros.

Características principales

- Transcripciones en vivo para Google Meet, Zoom y Microsoft Teams

- Resúmenes generados por IA para destacar las decisiones y los elementos de acción clave

- Kits de reuniones con IA e indicaciones personalizadas para crear resúmenes personalizados, tickets de Jira o actualizaciones de proyectos

- Flujos de trabajo de para automatizar el seguimiento, la creación de tareas y el intercambio de información

- Traducción en tiempo real durante llamadas en más de 50 idiomas

- Cargar archivos de vídeo y audio para transcripciones y resúmenes instantáneos

- Búsqueda rápida e identificación de altavoces para revisar quién dijo qué en segundos

¿Quieres disfrutar de los beneficios de los resúmenes basados en inteligencia artificial sin preocuparte por los límites de tokens de ChatGPT? Instala la extensión gratuita de Tactiq para Chrome — gratis para empezar.

Avanzando

ChatGPT es una herramienta poderosa, pero los límites de los tokens pueden interrumpir rápidamente conversaciones largas, indicaciones detalladas o proyectos complejos. Saber cómo funciona el uso de los tokens te ayuda a mantenerte dentro de los límites de cada modelo, pero gestionar el historial de entradas, salidas y conversaciones requiere un esfuerzo adicional.

Si su prioridad son las notas y los resúmenes de las reuniones, Tactiq ofrece una mejor opción. Al conectarse directamente a plataformas como Google Meet, Zoom y Microsoft Teams, captura tus conversaciones en tiempo real y ofrece transcripciones, resúmenes y elementos de acción listos para usar. No es necesario hacer malabares con las fichas.

👉 Prueba Tactiq hoy y convierta cada reunión en información valiosa sobre la que pueda actuar.

Preguntas frecuentes sobre los límites de los tokens de ChatGPT

¿Cuántos tokens puede gestionar ChatGPT?

Depende del modelo y del plan. GPT-5 Free admite alrededor de 8K, Plus hasta 32K y Pro/Enterprise hasta 128K. El acceso a la API puede alcanzar los 256 000. Los límites de los tokens cambian con frecuencia, especialmente cuando se lanzan nuevos modelos, así que compruébalo IA abierta para conocer las últimas novedades.

¿Cuáles son las funciones incluidas en la versión gratuita de ChatGPT?

Los usuarios gratuitos reciben GPT-5 con límites de uso, 1 respuesta GPT-5 Thinking por día y una alternativa a GPT-5 Mini una vez que se alcanzan los límites.

¿Cuál es el límite de mensajes de ChatGPT-5?

Los usuarios gratuitos reciben 10 mensajes GPT-5 cada 5 horas. Los usuarios Plus reciben 160 cada 3 horas, mientras que los planes Pro y Enterprise permiten un uso aún mayor.

¿Qué funciones adicionales ofrece el plan ChatGPT Plus?

Además, ofrece límites de mensajes más altos, contexto más extenso, respuestas más rápidas y acceso a herramientas avanzadas como DALL·E y el análisis de datos.

¿Cómo puedo sortear el límite de tokens de ChatGPT?

Resuma las entradas, divida el texto largo entre las llamadas a la API y establezca la longitud de las respuestas. O usa Tactiq para tomar notas de reuniones sin límite de fichas.

Sí, tiene límites de tokens para las ventanas de contexto, según su plan y modelo. Estos planes se adaptan a las diferentes necesidades de los usuarios, tanto si se trata de una persona que acaba de empezar como de una empresa que busca soluciones escalables.

ChatGPT puede gestionar diferentes números de tokens para las ventanas de contexto según el modelo que utilice. ChatGPT-3.5 gestiona hasta 8000 fichas, mientras que ChatGPT-4 de los planes Plus y Team puede gestionar hasta 32 000 fichas. En el caso de ChatGPT Enterprise, puede procesar hasta 128 000 fichas. Cada modelo puede tener límites distintos para los tokens de entrada y salida, por lo que es mejor consultar las directrices del modelo para obtener detalles específicos.

La versión gratuita de ChatGPT incluye mensajes, interacciones e historial ilimitados con acceso al modelo GPT-3.5.

El límite de mensajes para ChatGPT-4 está establecido para los usuarios de ChatGPT Plus en 40 mensajes cada 3 horas. Este límite puede cambiar según la demanda y el rendimiento del sistema. No es posible almacenar los mensajes no utilizados para usarlos en el futuro.

El plan Plus ofrece acceso al GPT-4, tiempos de respuesta más rápidos, una ventana de contexto más amplia y herramientas adicionales como DALL·E y Advanced Data Analysis.

Get live transcriptions without an AI bot joining the meeting.

Prueba Tactiq para tu próxima reunión.

¿Quiere disfrutar de la comodidad de los resúmenes de IA?

Prueba Tactiq para tu próxima reunión.

¿Quiere disfrutar de la comodidad de los resúmenes de IA?

Prueba Tactiq para tu próxima reunión.